ChatGPT vs 로컬 LLM — 실제 사용 비용 비교 6개월

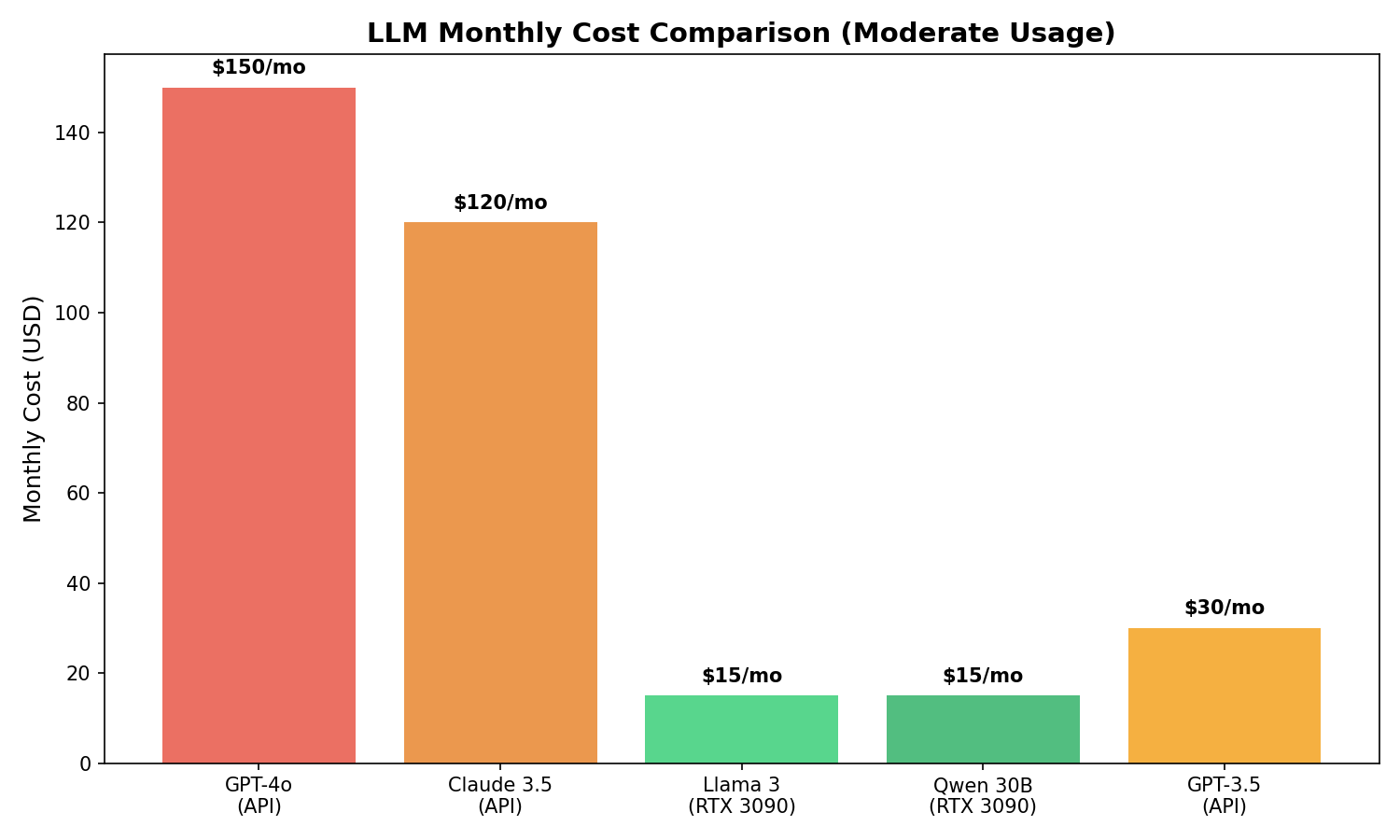

ChatGPT API와 로컬 LLM(Ollama + RTX 3090)을 6개월간 실제 운영하며 비용을 비교한 경험기. 전기세, GPU 감가상각, API 요금까지 꼼꼼히 따져봤습니다.

왜 비용을 직접 비교하게 되었나

2025년 여름, ChatGPT API 비용이 월 30만 원을 넘기기 시작했다. 논문 요약, 코드 리뷰, 블로그 초안 작성 등 매일 수십 번의 API 호출을 하다 보니 토큰 비용이 눈덩이처럼 불어났다. "이 돈이면 GPU를 사서 로컬에서 돌리는 게 낫지 않을까?" 하는 생각이 자연스럽게 들었다.

그래서 2025년 8월부터 2026년 1월까지, 정확히 6개월간 ChatGPT API(GPT-4o)와 로컬 LLM(Llama 3.1 70B, Mistral 등)을 병행 운영하면서 모든 비용을 기록했다. 이 글은 그 실제 데이터를 기반으로 한 비교 보고서다.

실험 환경

ChatGPT API 쪽

- 모델: GPT-4o (주력), GPT-4o-mini (간단한 작업)

- 용도: 논문 요약, 코드 리뷰, 번역, 블로그 초안

- 호출량: 일 평균 40-60회, 월 평균 1,500회

- 측정 도구: OpenAI Usage Dashboard + 자체 로깅 스크립트

로컬 LLM 쪽

- 하드웨어: RTX 3090 24GB (중고 65만 원 구매)

- 모델: Llama 3.1 70B (Q4_K_M), Mistral 7B, CodeLlama 34B

- 프레임워크: Ollama + Open WebUI

- 전력 측정: 스마트 플러그(TP-Link Tapo P110)로 실시간 전력 모니터링

6개월 비용 상세 내역

ChatGPT API 비용 (월별)

| 월 | GPT-4o | GPT-4o-mini | 합계 |

|---|---|---|---|

| 2025.08 | ₩285,000 | ₩12,000 | ₩297,000 |

| 2025.09 | ₩310,000 | ₩15,000 | ₩325,000 |

| 2025.10 | ₩340,000 | ₩18,000 | ₩358,000 |

| 2025.11 | ₩295,000 | ₩14,000 | ₩309,000 |

| 2025.12 | ₩320,000 | ₩16,000 | ₩336,000 |

| 2026.01 | ₩330,000 | ₩17,000 | ₩347,000 |

| 합계 | ₩1,972,000 |

로컬 LLM 비용

- GPU 구매: ₩650,000 (중고 RTX 3090, 감가상각 월 ₩36,111 × 18개월)

- 전기세: 월 평균 ₩28,000 (하루 평균 6시간 풀로드, 350W)

- 기타: SSD 1TB 추가 ₩89,000, 쿨링 팬 ₩25,000

6개월 총 로컬 비용: GPU 감가 ₩216,666 + 전기세 ₩168,000 + 기타 ₩114,000 = ₩498,666

비용 차이: 약 150만 원

6개월 기준 ChatGPT API 대비 로컬 LLM이 약 150만 원 저렴했다. 물론 이 수치에는 내 시간(설정, 트러블슈팅, 모델 선택)이 포함되어 있지 않다. 시간당 가치를 5만 원으로 잡으면 초기 세팅에 약 20시간(100만 원 상당)이 들었으니, 순수 비용 이점은 첫 해 기준 약 50만 원 정도다.

품질 비교 — 어디서 차이가 나는가

비용만 보면 로컬이 압승이지만, 품질은 이야기가 다르다.

GPT-4o가 확실히 우세한 영역

- 복잡한 추론: 다단계 논리 전개, 수학적 증명

- 최신 정보 반영: 2026년 최신 논문 내용 질의

- 다국어 뉘앙스: 한영 번역의 자연스러움

- 긴 컨텍스트: 128K 토큰 윈도우 활용

로컬 LLM이 충분한 영역

- 코드 자동완성: CodeLlama 34B가 간단한 코드 작업에 충분

- 텍스트 요약: Llama 3.1 70B의 요약 품질이 GPT-4o의 85-90% 수준

- 반복 작업: 템플릿 기반 텍스트 생성, 데이터 전처리

- 프라이버시 민감 데이터: 환자 데이터, 내부 문서 처리

실제로 나는 현재 하이브리드 전략을 사용한다. 단순 반복 작업은 로컬, 고품질이 필요한 작업은 API. 이렇게 하니 API 비용이 월 12만 원 선으로 떨어졌다.

Ollama 실제 운영 팁

6개월간 Ollama를 메인 프레임워크로 사용하면서 얻은 실전 팁을 공유한다.

모델 선택 전략

# 빠른 응답이 필요한 경우

ollama run mistral:7b-instruct-v0.3

# 품질이 중요한 경우 (Q4 양자화)

ollama run llama3.1:70b-instruct-q4_K_M

# 코드 작업

ollama run codellama:34b-instruct

VRAM 관리

RTX 3090의 24GB VRAM은 70B 모델의 Q4 양자화 버전을 간신히 올릴 수 있다. 실제로 Llama 3.1 70B Q4_K_M은 약 22GB를 사용하며, 나머지 2GB로 KV 캐시를 운영해야 한다. 컨텍스트 길이를 4096으로 제한해야 안정적으로 돌아간다.

응답 속도

- Mistral 7B: 약 45 tok/s — 체감상 GPT-4o보다 빠름

- Llama 3.1 70B Q4: 약 8-12 tok/s — 체감상 느리지만 참을 만함

- CodeLlama 34B: 약 18-22 tok/s — 코드 작업에 적당

전기세 상세 분석

스마트 플러그로 측정한 실제 전력 데이터가 흥미로웠다.

- 아이들 상태: 약 85W (시스템 전체)

- Mistral 7B 추론: 약 220W

- Llama 70B 추론: 약 340W

- 모델 로딩 피크: 약 380W

하루 평균 사용 패턴(6시간 추론 + 18시간 아이들)으로 계산하면:

- 일 전력: (340W × 6h) + (85W × 18h) = 3,570Wh ≈ 3.57kWh

- 월 전력: 3.57 × 30 = 107.1kWh

- 월 전기세: 약 ₩28,000 (주택용 전력 기준)

이 수치는 에어컨 한 대를 하루 3시간 돌리는 것과 비슷한 수준이다.

결론: 누구에게 뭘 추천하는가

| 상황 | 추천 |

|---|---|

| 월 API 비용 10만 원 이하 | ChatGPT API 유지 |

| 월 API 비용 20만 원 이상 | 로컬 LLM 도입 검토 |

| 프라이버시 중요 | 로컬 LLM 필수 |

| 최고 품질 필요 | ChatGPT API (또는 하이브리드) |

| GPU 이미 보유 | 무조건 로컬 시도 |

개인적으로는 하이브리드 전략이 최적이라고 생각한다. 로컬 LLM으로 80%의 작업을 처리하고, 나머지 20%만 API를 사용하면 비용과 품질 모두를 잡을 수 있다.

뇌과학 연구에서도 비슷한 패턴이 있다. 뇌는 에너지 효율을 극도로 추구하면서도, 중요한 순간에는 자원을 집중 투입한다. LLM 운영도 마찬가지다 — 일상적인 작업은 효율적으로, 중요한 작업은 최고 품질로.

참고 자료 및 관련 링크

- Ollama 공식 사이트 — 로컬 LLM 프레임워크

- Hugging Face Open LLM Leaderboard — 오픈소스 LLM 성능 비교

- OpenAI API Pricing — ChatGPT API 요금표

- arXiv: Llama 3 논문 — Meta의 Llama 3 기술 보고서

- 로컬 AI 시스템 구축 가이드 — 시스템 구축 관련 정보

- 생물정보학과 AI 융합 연구 — 바이오인포매틱스 AI 활용

- 유전체 데이터 분석과 AI — 유전체 기반 AI 분석

- 한국 생물학 연구정보센터 — 국내 생명과학 연구 커뮤니티